Z-Image Turbo 글 보다가 OpenVINO 부분에서 멈춰버림

Alibaba Tongyi 팀의 Z-Image Turbo 모델을 OpenVINO로 변환해 INT4 양자화까지 적용하는 영문 글을 한국 개발자 입장에서 다시 정리. 모델 자체의 매력과 INT4 압축의 흥미로운 부분, NVIDIA 중심 생태계에서 Intel 트랙이 갖는 애매한 위치, custom branch 의존성으로 인한 production 적용의 위험성을 솔직하게 짚어봤습니다.

이미지 생성 사이트 운영하다 보면 step 수 적은 모델은 거의 자동반사로 눌러보게 됩니다. latency가 곧 비용이라서요. 그 결로 Z-Image Turbo 글을 하나 읽었는데, OpenVINO로 변환해서 INT4 양자화까지 적용하는 흐름이라 끝까지 봤음. 근데 중간쯤 가서 좀 갸웃해졌어요.

Z-Image Turbo가 뭔가

간단히 정리하면 Alibaba 산하 Tongyi 팀에서 낸 텍스트→이미지 모델임. 공식 모델 카드에 따르면 6B 파라미터 DiT 아키텍처고, 8~9 step 정도면 결과가 나옵니다. 이름 그대로 Turbo 계열이라 distilled 모델 특유의 룰—guidance_scale=0으로 두라는—을 따르고요.

SDXL Turbo, SD3.5 Turbo 계열의 연장선 같은 느낌인데 6B면 살짝 묵직한 편. 직접 돌려본 건 아니라 품질 체감은 모르겠고, 모델 카드의 샘플들만 보면 디테일은 꽤 살아있어 보였어요.

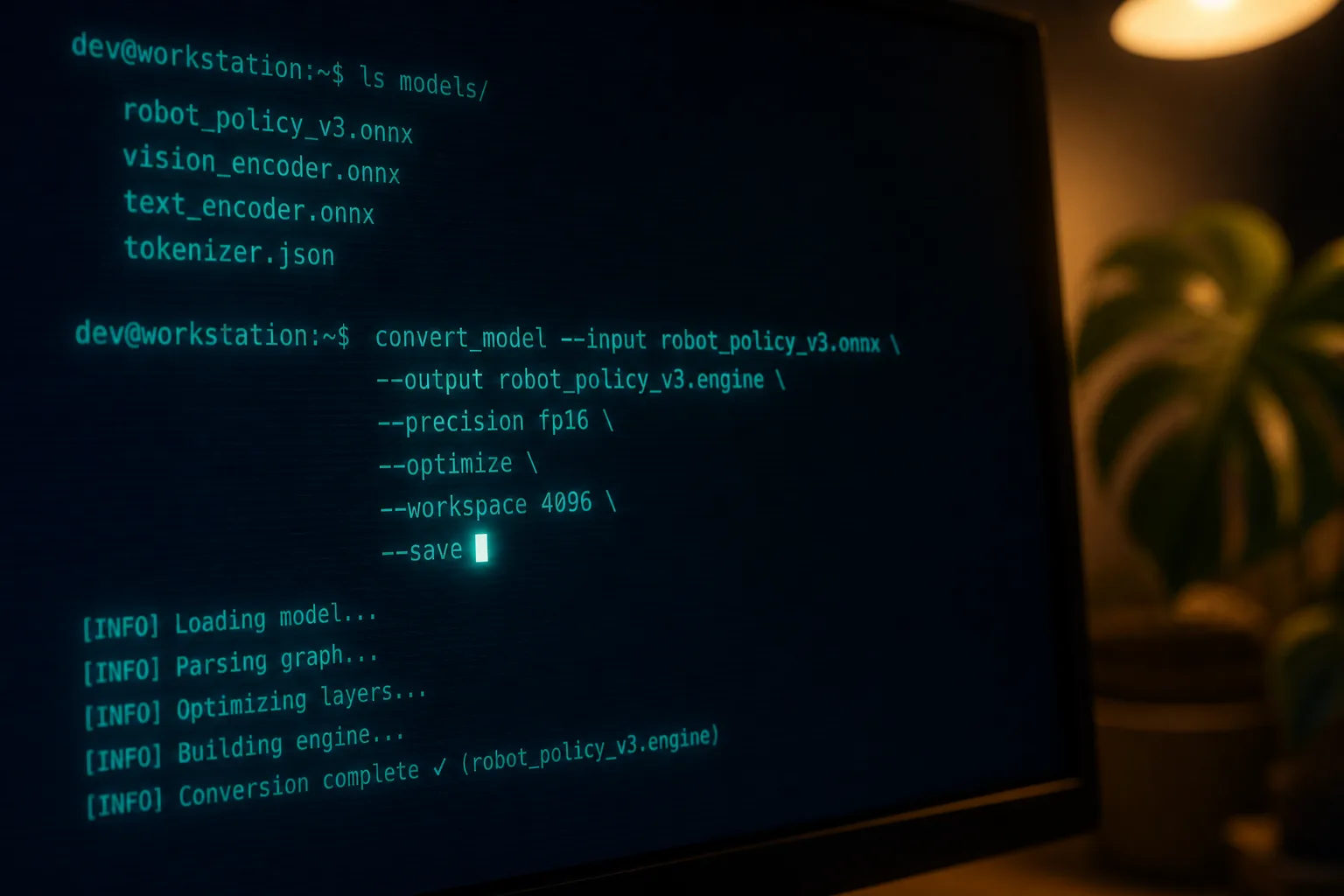

글에서 보여준 흐름

대충 이렇게 진행됩니다.

optimum-cli export openvino \

--model Tongyi-MAI/Z-Image-Turbo \

--task text-to-image \

Z-Image-Turbo-ov \

--weight-format int4 --group-size 64 --ratio 1.0이 한 줄로 PyTorch 가중치를 OpenVINO IR 포맷으로 바꾸면서 동시에 INT4로 압축해버리는 구조거든요. 그 다음 추론은 OVZImagePipeline.from_pretrained(...)로 로드해서 device="gpu"로 실행. 여기서 헷갈리지 말아야 할 게, 저 gpu는 NVIDIA가 아니라 Intel iGPU나 Arc를 의미합니다. 처음엔 무심코 "CUDA 어디 갔지" 생각했음.

갸웃해진 지점

근데 솔직히, 이미지 생성 모델 돌리는 사람 대부분은 NVIDIA 기반이에요. Stable Diffusion 생태계 자체가 CUDA에 박혀 있고, A1111이든 ComfyUI든 PyTorch + xformers + CUDA 콤보가 디폴트죠. OpenVINO는 좋은 툴인데 이미지 생성 영역에선 한참 마이너 트랙임.

그래서 이 글의 가치를 어디서 찾아야 하나 잠깐 멈췄는데, 정리해보면 두 가지로 나뉘더라고요.

하나는 Intel iGPU나 Arc 가진 사람한텐 진짜 유용함. NPU 들어간 노트북에서 6B DiT를 그럭저럭 돌릴 수 있다는 건 의미가 작지 않아요. 클라우드 비용 안 쓰고 로컬에서 텍스트→이미지 돌려야 하는 시나리오, 사내 데모나 PoC 같은 자리에선 가치가 분명함.

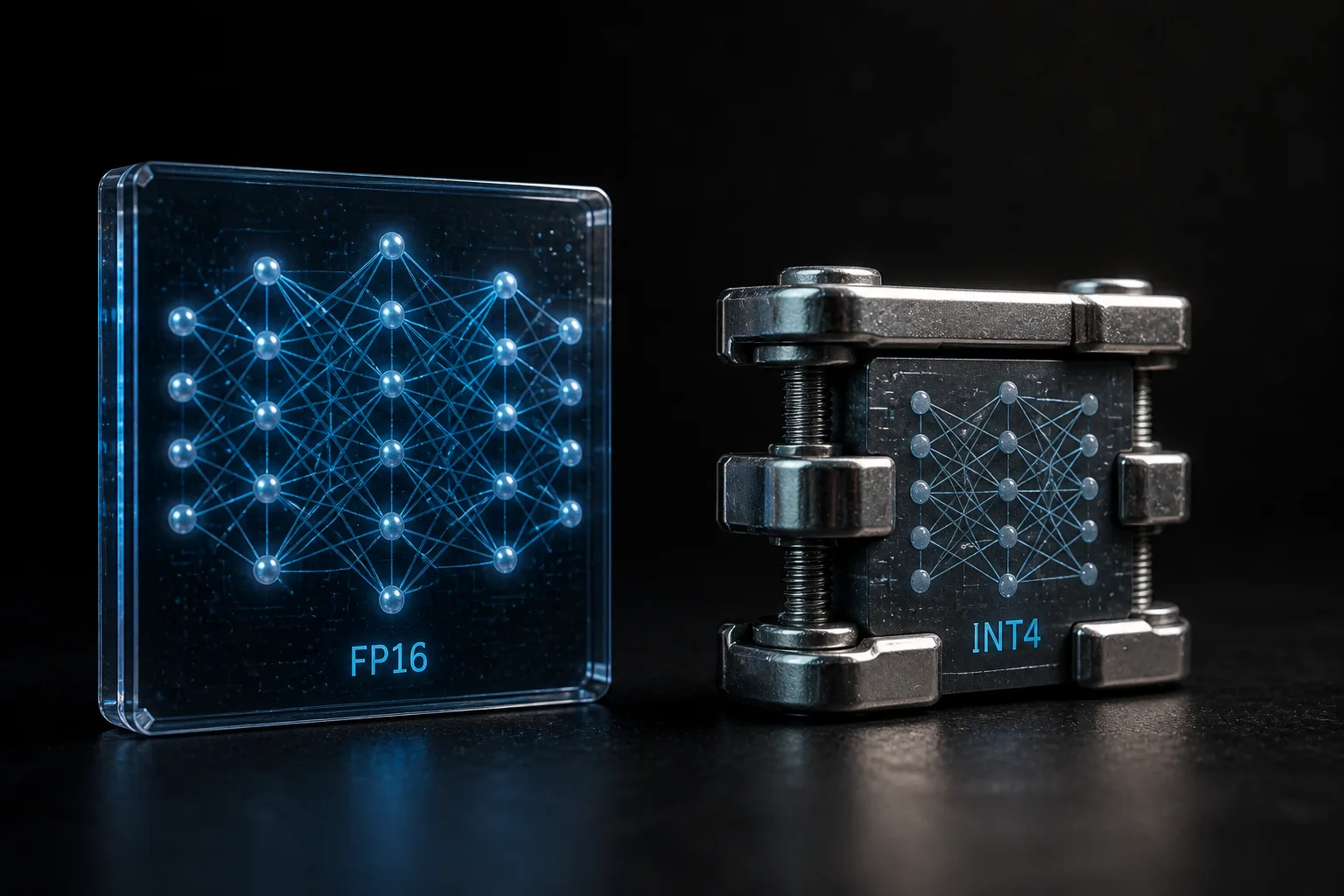

다른 하나는 INT4 양자화 자체가 재밌는 포인트라는 거. NNCF 기반 가중치 압축인데, GPTQ나 AWQ 같은 LLM 양자화는 이제 익숙해도 diffusion 모델 양자화는 production에서 아직 흔하지 않거든요. 6B 모델을 INT4로 떨궜을 때 품질 손실이 어느 정도인지는 안 돌려봐서 모르겠는데, 글에서도 "품질 더 원하면 fp16으로 가라" 정도로 적당히 빠져나가더라고요. 이 한 줄에서 약간 솔직하다는 인상을 받았음.

그리고 가장 걸리는 부분

이게 사실 글 읽다가 제일 신경 쓰였던 지점인데, 이런 노트가 박혀 있어요. "이 예제는 OpenVINO에서 완전히 검증되지 않은 모델이며, optimum-intel의 custom branch를 사용합니다." 그리고 실제 셋업 명령어를 보면:

pip install git+https://github.com/huggingface/diffusers.git@a1f36ee...

pip install git+https://github.com/openvino-dev-samples/optimum-intel.git@5aa4c4ba...특정 commit hash를 박아둔 fork를 두 개나 깔아야 합니다. 이게 뭐가 문제냐면, 몇 달 지나서 이 글대로 따라 하면 다른 패키지와 dependency가 어긋나서 깨질 가능성이 매우 높아요. 시간이 더 흐르면 fork 자체가 stale해지거나, 메인에 머지된 다른 형태가 표준이 되거나 둘 중 하나거든요. 요즘 huggingface 생태계 진짜 빠르게 움직이잖아요.

production에 넣을 거면 optimum-intel main 브랜치에 OVZImagePipeline이 머지될 때까지 기다리는 게 합리적입니다. 데모/실험이면 지금 따라 해도 되긴 하는데, 한 번 환경 깨지면 디버깅이 좀 짜증날 거예요.

잡담—한복 프롬프트

얘기 나온 김에, 글에 들어 있는 예제 프롬프트가 하나 있는데 한복 입은 여성에 시안 대안탑(西安大雁塔)이 배경으로 깔리는 구도였어요. 정확히는 "Hanfu"라고 적혀 있는데, 한국인 입장에서 영어 hanfu를 한복으로 자동 읽게 됨. 한복(韓服)이랑 한푸(汉服)는 다른 옷이긴 한데, 영문 표기가 같다 보니 살짝 묘했음.

중국 모델이라 동아시아 의상에 강하게 튜닝된 건지, 아니면 데모 프롬프트 선택의 문제인지는 모르겠고. 어쨌든 동아시아 텍스트나 의상 표현이 강한 모델인 건 분명해 보입니다. 이게 한국어 프롬프트도 잘 받는지는 별개의 문제고요.

정리하자면

Z-Image Turbo 자체는 따라가볼 만합니다. 6B에 8 step이면 가성비 자체는 좋고, 동아시아 시각 데이터에 강한 점이 의외로 차별점이 될 수도 있어요. OpenVINO + INT4 조합은 Intel 환경 가진 사람한텐 충분히 매력 있는 선택지인데, 그 외엔 호기심으로 한 번 깔아보는 정도가 맞다고 봄. NVIDIA 환경이면 그냥 diffusers + bitsandbytes 4bit 쓰는 게 빠를 듯하고요.

그리고 custom branch 의존성. 이거 진짜 production 도입은 좀 더 기다려도 됩니다. 두 달 뒤에 깨져도 글 쓴 사람은 책임 안 져주거든요.

다음에는 INT4 diffusion 양자화 자체를 좀 더 파보려고 함. NNCF가 정확히 뭘 하는지, GPTQ랑 AWQ랑 어떻게 다른지, 이미지 모델에서 INT4 갈 때 품질이 어디서부터 무너지는지—이런 결로요. 이건 직접 돌려보고 쓸 수 있어서 더 재밌을 것 같네요.

댓글

NEXT_PUBLIC_GISCUS_*환경변수 구성 필요)