object detection 비교 튜토리얼인데 사진 한 장으로 끝났음

"Faster R-CNN vs SSD 완벽 비교"를 자처한 PyTorch 튜토리얼을 봤는데, 실제로는 사진 한 장에 두 모델 inference 한 번씩 돌리고 끝났음. 영어권 ML 튜토리얼 매체에서 자주 보이는 SEO-friendly "deep dive" 글의 흔한 패턴, mAP/FPS 없는 비교가 비교가 아닌 이유, 그리고 2026년에 거의 10년 전 모델 비교를 마케팅 키워드로 거는 게 의미 있는지에 대한 회의 메모.

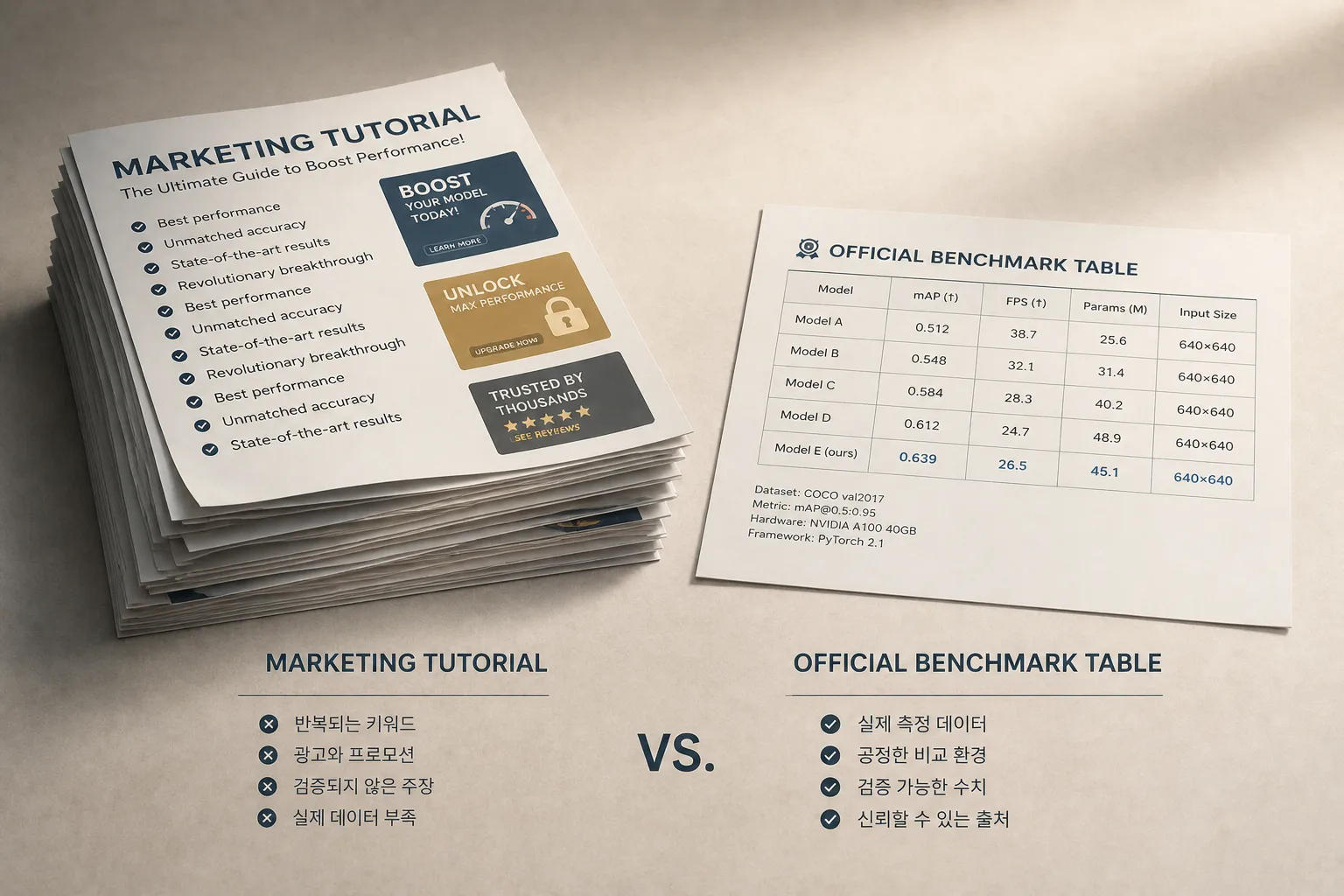

영어권 ML 매체에 "X vs Y 완벽 비교" 류 튜토리얼이 정말 자주 풀림. 최근 1~2주 사이만 봐도 비슷한 형식의 글이 두세 번 보였고, 글마다 패턴이 거의 똑같아요. 같은 키워드를 본문에 30번씩 박고, FAQ로 길이 늘리고, affiliate 링크 몇 개 끼워넣고, 마지막엔 "이걸로 합리적인 결정을 내릴 수 있게 됐다"로 끝맺는 식. 며칠 전 본 Faster R-CNN vs SSD 비교 튜토리얼도 정확히 이 패턴이었음. 흥미로웠던 건 글이 자처한 깊이와 실제 깊이의 갭이 너무 컸다는 거.

글이 자처한 것

제목과 도입에서 약속한 건 명확함. 두 모델 — 정확도 우선의 two-stage 검출기인 Faster R-CNN과 속도 우선의 single-shot 검출기인 SSD — 을 deep dive로 비교해서, 의료 영상 같은 정밀 작업이냐 모바일·로보틱스 같은 실시간 작업이냐에 따라 어느 쪽을 골라야 할지 알려주겠다는 거였음. 키워드는 "speed-accuracy trade-off", "production-ready", "informed deployment decisions". 단어 자체는 흠잡을 데 없음.

글이 실제로 한 것

사진 한 장에 Faster R-CNN 한 번 돌리고, 같은 사진에 SSDLite 한 번 돌리고, 각각 bounding box 그림. 끝.

torchvision에서 pre-trained weight 로드해서 model.eval() 호출하고 텐서 변환해서 inference하는 게 코드의 거의 전부임. PyTorch 처음 만지는 사람한테 "두 모델 시동 거는 법" 보여주는 hello world 두 개를 옆에 붙여놓은 거지, 비교가 아닙니다. 이걸 "deep dive comparison"이라고 부르는 게 진짜 부적절함.

진짜 비교라면 뭐가 있어야 하나

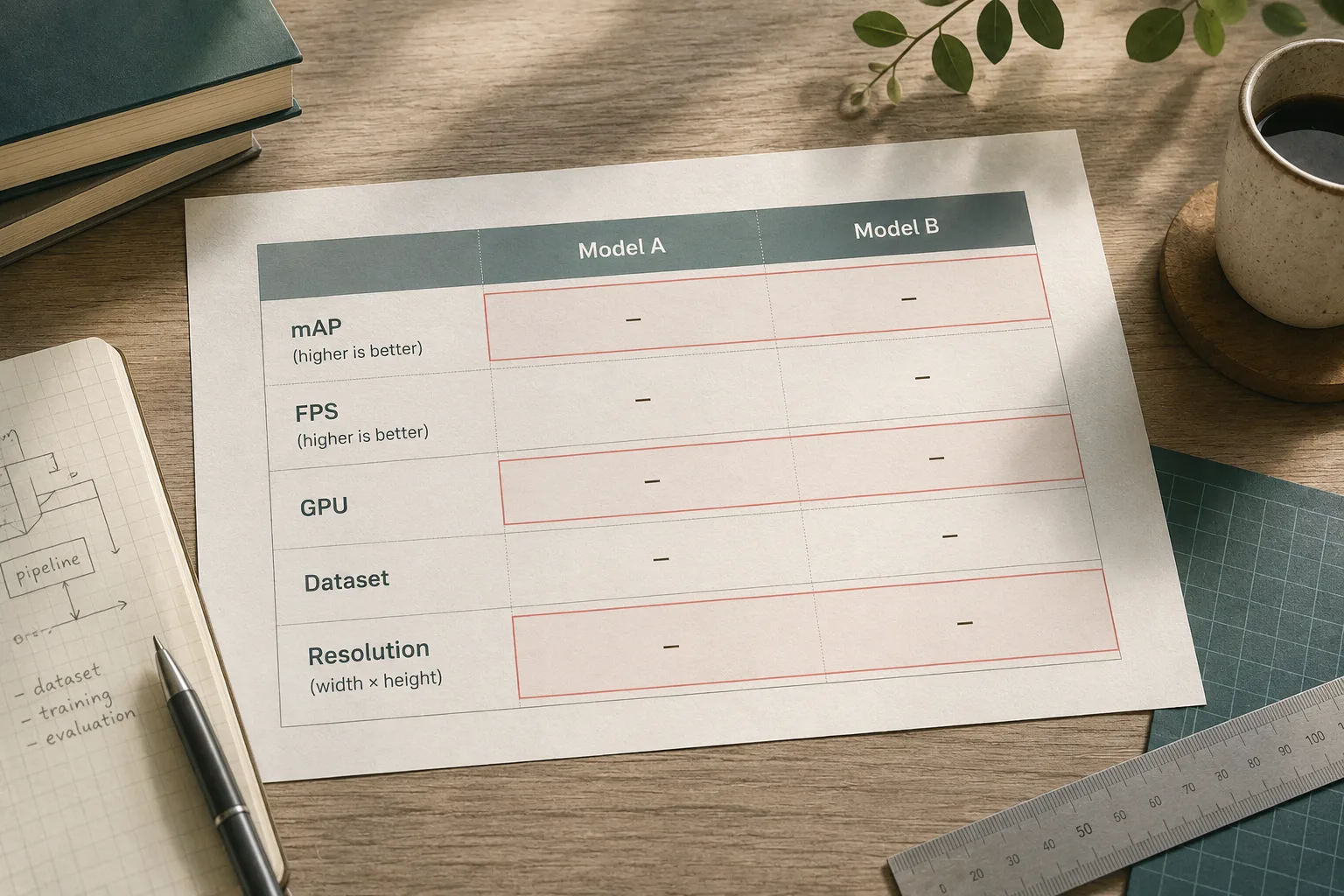

object detection 모델 비교에는 적어도 두 가지 metric이 있어야 함. mAP (mean Average Precision — 다양한 IoU 임계값에서 평균 정밀도, 정확도 지표)와 FPS (frames per second, 처리 속도 지표). 이 둘 없이 정확도-속도 trade-off를 논하는 건 그냥 단어 늘어놓기임. 그리고 이 두 숫자도 어떤 데이터셋, 어떤 입력 해상도, 어떤 GPU 에서 측정했는지가 같이 적혀있어야 의미가 있음.

원글에는 이 정보가 0개임. 사진 한 장의 confidence score 0.5 이상 박스만 그려보면, 두 모델이 다른 박스를 그린다는 사실 정도밖에 안 보임. 이걸로 "production deployment decision"을 어떻게 한다는 건지 모르겠음. 이거 진짜로 misleading함.

직접 Faster R-CNN/SSD를 production scale로 운영한 적은 없지만, 공개된 벤치마크들 (torchvision 자체 docs, papers with code 등)만 봐도 두 모델의 trade-off는 훨씬 더 nuanced함. SSD가 항상 빠른 것도 아니고, Faster R-CNN이 항상 정확한 것도 아닙니다. 작은 객체에서는 Faster R-CNN의 RPN이 강하지만, 같은 GPU에서 두 자릿수 FPS가 안 나오는 케이스도 있어서 "real-time"인지 아닌지가 갈림. 이런 디테일이 빠진 비교는 쓸모없음.

그리고 2026년에 이 비교가 의미 있는가

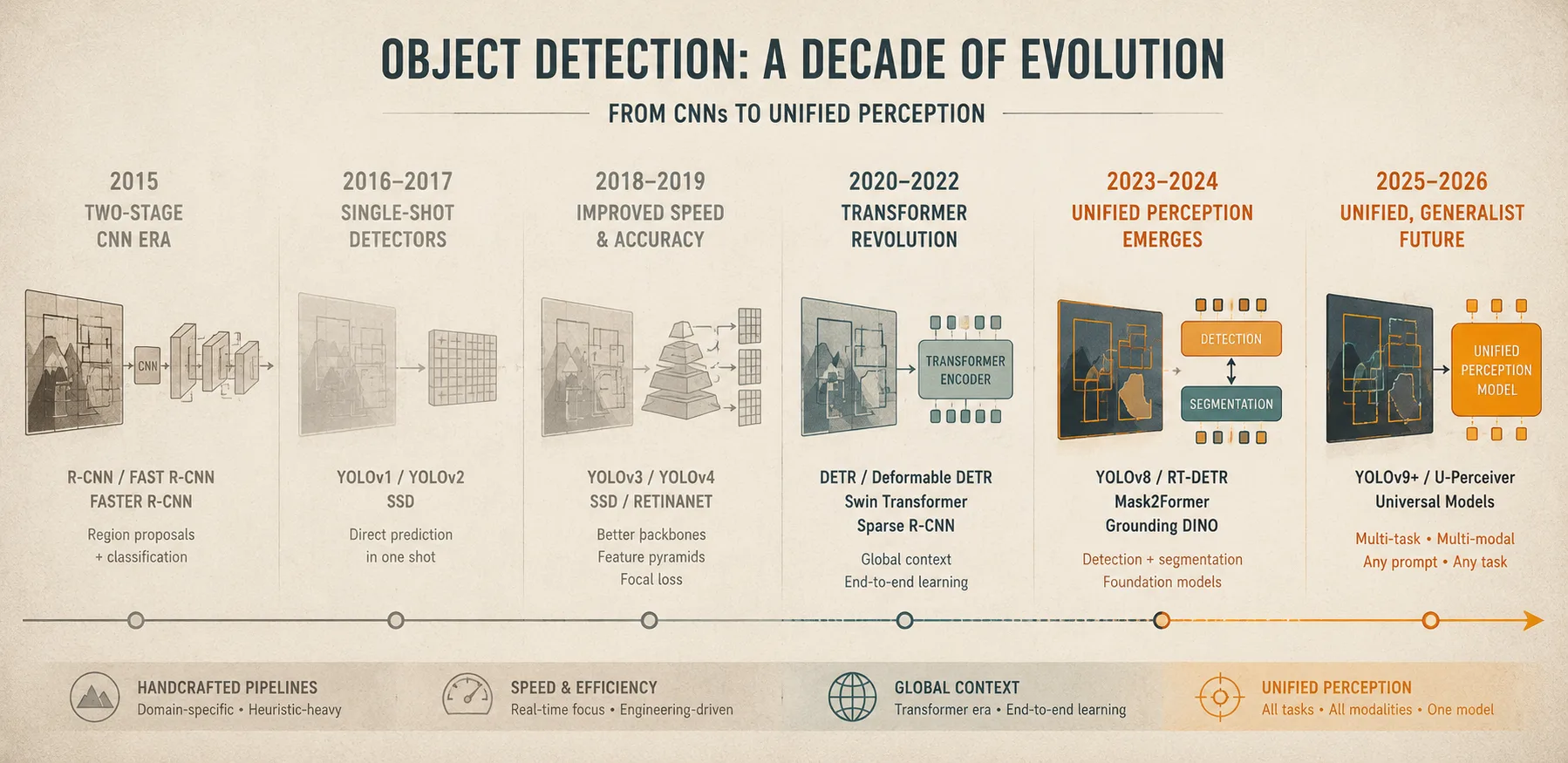

좀 더 본질적인 부분. 2026년 시점에 Faster R-CNN과 SSDLite를 메인 옵션으로 두고 비교하는 게 합리적인가? 직접 production에 deploy해본 게 많지는 않지만, 후기랑 모델 카드들 살펴보면 흐름은 명확함. 모바일·실시간 영역은 YOLO 계열 (YOLOv8, v10, v11)이나 RT-DETR이 주류로 넘어왔음. 정확도 영역도 DETR 계열이 transformer 기반으로 한참 앞서있음. Faster R-CNN과 SSD는 둘 다 2015~2016년에 처음 발표된 모델임. 10년 전 모델임.

물론 두 모델이 학습용으로는 여전히 가치가 있음. torchvision 기본 제공이고 컴퓨터비전 입문 코스에서 가장 자주 다루는 아키텍처. 근데 2026 키워드를 키워드 박스에 박고 "production deployment decisions"을 논하는 글에서 이걸 메인 비교로 두는 건 SEO 외 이유를 찾기 어려움. 이거 그냥 검색 트래픽을 위한 패키징인 듯.

잡담

영어권 ML 튜토리얼 글에서 "deep dive"라는 단어가 너무 흔해진 듯합니다. 단어 자체에 인플레이션이 와서, 이젠 deep dive라고 자처한 글은 오히려 깊지 않을 가능성이 높다는 신호로 받아들여도 될 정도. "comprehensive guide", "the ultimate", "everything you need to know" 같은 단어들도 비슷함. 한국어 매체로 번역되어 들어올 때도 이 패턴이 그대로 옮겨오는 경우가 많아서 좀 안타까움. 진짜 깊은 글은 이런 단어를 거의 안 씁니다.

정리

비교 튜토리얼을 자처하는 글이라면 적어도 mAP·FPS·하드웨어·데이터셋 정보가 같이 있는 표 한 장은 있어야 함. 없으면 그건 튜토리얼이지 비교가 아님. 영어권 매체의 "X vs Y deep dive" 류 글 중 상당수가 이 기준에 못 미치는 듯합니다. 키워드 검색으로 들어와서 빠르게 빠지는 트래픽을 위한 콘텐츠지, 모델 선택의 실제 의사결정에 도움 주는 글은 아님. 사진 한 장에 박스 그린 거 보고 deployment 결정 내리지 마요.

torchvision detection models 공식 docs는 적어도 각 모델의 box mAP를 표로 정리해두고 있으니까 비교 시작점으로 이쪽이 더 정직합니다. SEO 튜토리얼 대신 여기를 보는 게 빠름.

댓글

NEXT_PUBLIC_GISCUS_*환경변수 구성 필요)